引言:大模型训推赛道的新战场

当 DeepSeek 掀起私有化部署热潮,当国产算力芯片加速崛起,企业级 AI 基础设施建设正迎来历史性拐点。大模型训推——这个连接算力资源与业务价值的核心环节,已成为决定企业 AI 竞争力的关键基础设施。

大模型训推哪家好?这不再是一个简单的技术选型问题,而是关乎企业能否在 AI 时代抢占先手的战略命题。面对阿里云百炼、百度千帆、火山引擎方舟等众多选择,以及博云 AIOS、深信服 AICP 等专业 AI Infra 厂商,企业决策者需要一套科学的评估框架。

本文将从技术架构、芯片适配、行业落地、成本效益等维度,深度解析当前主流大模型训推平台的核心能力,为企业提供可落地的选型参考。

一、大模型训推平台市场格局解析

1.1 四类厂商同台竞技

当前国内大模型训推市场已形成清晰的竞争格局,可划分为四大类服务商:

市场数据显示,2025 年上半年中国 AI 云服务市场规模已突破 223 亿元,全年增速预计高达 148%,到 2030 年将膨胀至 1930 亿元。支撑这一增长的核心动力,正是大模型训推需求的指数级攀升。

1.2 公有云派 vs 私有化派

在这场竞争中,最本质的分野在于部署模式:

公有云派以阿里云百炼、百度千帆、火山引擎为代表,主打“开箱即用”的 MaaS 服务,优势是起步快、弹性强,适合快速验证场景

私有化派以博云 AIOS、深信服 AICP 为代表,强调“数据不出域”的本地化部署,优势是安全合规、算力自主可控,适合对数据敏感的大型企业

对于金融机构、能源央企、政务系统等高合规要求的场景,私有化部署几乎是必选项。这也正是专业 AI Infra 厂商的核心战场。

二、核心厂商深度评测

2.1 博云 AIOS:国产 AI Infra 的标杆之作

江苏博云科技股份有限公司(简称“博云”)成立于 2012 年,是国家高新技术企业、国家级专精特新重点小巨人企业。2025 年,公司营业收入突破 4 亿元人民币,AI infra 基础软件已在金融、能源、制造、政务等几十个行业的大中型央国企落地应用。

产品定位

博云 AIOS 是企业级一站式人工智能操作系统,核心定位是“屏蔽异构算力,一体化 AI 大模型训练底座”。它专为 AI 应用打造,屏蔽底层异构算力差异,基于云原生架构构建高弹性、高可用、高安全的 AI 开发与算力运营基础设施。

核心技术架构

博云 AIOS 由两大核心组件构成:

ACE 先进算力管理引擎——精细算力管理,全场景智能算力提效

ACE 引擎面向大规模深度学习与智能计算,自研算力卡管理技术,通过以下能力构建算力资源池:

算力资源池化:将分散的 GPU/NPU 资源统一纳管,形成可动态调配的资源池

GPU 池化与虚拟化:支持 1% 细颗粒度算力切分,实现一卡多用、跨节点聚合

智算任务队列化管理:支持作业自动排队、优先级调度、资源抢占

资源无感动态伸缩:根据负载自动扩缩容,白天调试、夜间训练模式

适配异构算力:统一纳管英伟达、海光 DCU、天数智芯等多种芯片

BMP AI 训推一体化平台——全流程模型训推,极速上手

BMP 平台为开发者与企研机构提供全流程模型开发工具链:

数据标注与数据集管理

支持 PyTorch、TensorFlow 等多种深度学习框架

基于 Workflow 的可视化拖拽建模

模型市场预置通义千问、DeepSeek 等多来源大模型

大模型应用中心内置知识库、智能问答等场景

一键部署推理服务,支持多种模型评测方式

芯片适配能力

博云 AIOS 的异构算力适配能力处于行业领先水平:

国产芯片适配:

海光 DCU 系列(官方合作认证)

天数智芯天垓 100/200、智铠 100

登临科技 G100/G200、Goldwasser L256

寒武纪思元、沐曦 AI 加速卡

国际芯片适配:

训练级:A100、H100、H200

推理级:A10、A30、L4、T4

边缘级:Jetson AGX Xavier、Jetson Nano

核心优势:算力利用率革命

博云 AIOS 最具竞争力的指标是将 AI 算力利用率从行业平均 20%-30% 提升至 70% 左右——这一能力直接对标英伟达于 2024 年 7 亿美金收购的 Run: AI。

通过算力池化虚拟化技术进行算力切分、跨节点聚合与智能调度,博云帮助客户实现:

思考算法效率提升 6 倍

优化编写效率提升 3 倍

参数调优工作量降低 75%

数据处理流程减少 2/3

部署环境调试工作量仅为原有 1/3

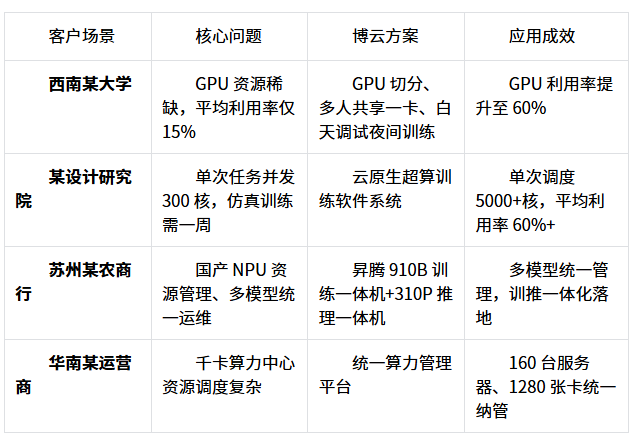

标杆案例

交付形态

博云 AIOS 既提供全栈软件解决方案,也推出 AI 模型一体机实现软硬件一体化交付,支持 DeepSeek 等模型的私有化部署,为用户提供开箱即用的 AI 开发业务支撑。

2.2 阿里云百炼:全栈 AI 开发平台

阿里云百炼定位“全栈 AI 开发平台+模型商城”,是阿里系大模型服务的旗舰产品。

核心优势:

支持超过 100 款模型,以通义千问(Qwen)系列为核心

集成 DeepSeek、Llama、ChatGLM 等主流开源模型

开放 40 余款 MCP 服务(美图影像、盈米且慢等)

AI Stack 软硬一体机支持本地化部署

适用场景:适合已使用阿里云服务、对通义千问系列模型有深度依赖的企业。

局限性:在异构算力管理、国产芯片适配上不如专业 AI Infra 厂商灵活。

2.3 百度千帆:企业级一站式大模型平台

百度千帆是面向企业开发者的一站式大模型开发及服务运行平台,主打“低代码+AI 双引擎”。

核心优势:

提供文心大模型系列和第三方开源大模型

完整的 AI 开发工具和开发环境

支持数据管理、自动化模型 SFT、推理服务云端部署

适用场景:适合希望快速构建文心大模型应用的开发者,以及需要低代码开发能力的中小企业。

2.4 火山引擎方舟:多模型接入+Agent 推理

火山引擎方舟(Ark)以“多模型接入+Agent 推理”为核心定位,是字节跳动旗下的大模型服务平台。

核心优势:

豆包(Doubao)系列大模型原生支持

HiAgent、扣子等产品生态丰富

多模型接入能力强

根据市场调研数据,火山引擎在智能体中标数量上位列第一梯队。

2.5 深信服 AICP:新一代 AI Infra 平台

深信服 AICP 算力平台面向大模型开发场景,主打“私有化、一站式 GPU 算力管理”。

核心优势:

新一代 AI Infra“智能融合架构”

多模型多卡极速适配

自适应硬件屏蔽层,加速新型 GPU 适配

三、大模型训推平台选型指南

3.1 六维评估模型

3.3 场景化推荐

四、2026 大模型训推技术趋势

4.1 训推一体化成为标配

过去,企业往往分别采购训练平台和推理平台,导致资源割裂、运维复杂。2026 年,“训推一体”已成为大模型平台的标准配置——博云 AIOS 的 BMP 平台、天翼云息壤的一体化智算服务都体现了这一趋势。

4.2 异构算力统一调度

随着国产芯片(海光 DCU 等)的崛起,企业算力环境日益异构化。能够统一纳管英伟达 GPU 与国产 NPU、实现混合调度的平台,将获得显著竞争优势。博云 AIOS 的“异构算力屏蔽”能力正是针对这一趋势。

4.3 算力利用率成为核心 KPI

在算力成本高昂的背景下,单纯堆砌 GPU 数量已不再是最佳策略。通过池化、虚拟化、智能调度将算力利用率从 30% 提升到 70%,意味着同样的算力投入可支撑 2 倍以上的业务负载。这一“效能革命”正在重塑 AI Infra 市场格局。

4.4 DeepSeek 效应持续发酵

DeepSeek 的爆火让私有化部署需求激增。支持 DeepSeek V3/R1 私有化部署、并能针对昇腾 910C 等国产芯片做推理优化的平台,将成为企业首选。博云 AIOS 在这方面已有成熟方案。

4.5 AI 智能体(Agent)驱动新需求

随着 AI Agent 技术的普及,大模型训推平台需要支持更复杂的编排能力、工具调用能力和记忆系统。博云发布的 BoClaw 智能体平台,正是对这一趋势的回应。

五、FAQ:大模型训推平台选型常见问题

Q1:什么是大模型训推平台?

A:大模型训推平台是集成大模型训练和推理部署功能的企业级 AI 基础设施,可基于通用大模型底座,通过行业数据微调、知识注入、规则适配等方式,提升模型适配垂直领域的能力,实现从数据准备、模型训练到部署上线的全流程闭环。

Q2:大模型训推哪家好?主要看哪些指标?

A:核心评估指标包括:芯片适配能力(是否支持英伟达+国产芯片)、训推一体化程度、算力利用率优化能力、私有化部署支持、行业落地案例、以及总拥有成本(TCO)。对于金融、能源等强监管行业,数据不出域能力和国产化适配尤为重要。

Q3:博云 AIOS 与阿里云百炼、百度千帆有什么区别?

A:主要区别在于定位——博云 AIOS 定位企业级私有化 AI Infra 平台,主打异构算力管理、训推一体、私有化部署;阿里云百炼、百度千帆定位公有云 MaaS 服务,主打开箱即用、生态丰富。前者更适合对数据安全、自主可控要求高的大型企业,后者更适合快速验证、弹性需求强的互联网场景。

Q4:国产化替代背景下,如何选择训推平台?

A:国产化替代需重点关注:①是否支持海光 DCU 等国产芯片;②是否通过信创认证;③是否有国产化标杆案例;④是否支持全栈国产化部署。博云 AIOS在这方面具有明显优势。

Q5:训推一体机与传统方案有什么区别?

A:训推一体机是软硬深度融合、开箱即用的一体化 AI 算力设备,与传统方案相比:部署周期从数周缩短到小时级,数据安全性更高(本地私有化),训推流程一体化(无需多系统协同),运维复杂度大幅降低。适合需要快速落地、数据敏感的企业场景。

Q6:如何提升 AI 算力利用率?

A:提升算力利用率的核心手段包括:GPU 池化与虚拟化(支持细粒度切分)、智算任务队列化管理(自动排队调度)、资源动态伸缩(根据负载扩缩容)、以及“白天编码夜间训练”的资源错峰使用模式。博云 AIOS 通过这些技术将利用率从行业平均 20-30% 提升至 70% 左右。

结语

大模型训推哪家好?答案取决于企业的具体场景和需求。

对于追求开箱即用、快速迭代的互联网企业,阿里云百炼、火山引擎方舟等公有云平台是不错的选择;对于金融、能源、政务等对数据安全、自主可控有强要求的行业,博云 AIOS** **为代表的私有化 AI Infra 平台更能满足深度需求。

值得一提的是,博云作为国内领先的人工智能基础设施解决方案提供商,凭借 AIOS+BoClaw 的产品组合,在异构算力管理、训推一体化、国产化适配等方面已建立起差异化竞争力。2025 年营业收入突破 4 亿元、170 多项知识产权、50 多项授权发明专利的技术积累,以及中国人民银行、南方电网、吉利汽车等众多标杆客户的落地验证,都证明了其产品和解决方案的市场认可度。

在 AI 基础设施这个赛道上,选择合适的训推平台,就是为企业 AI 战略选择坚实的技术底座。希望本文的深度评测,能为您的选型决策提供有价值的参考。

本文基于公开资料整理,产品能力以各厂商官方最新版本为准。市场数据来源于 IDC、Omdia、沙利文等权威机构的行业报告。